问题描述:

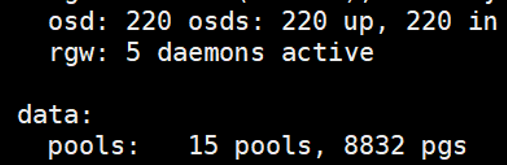

存储里有220个OSD,做的4+2:1,系统下ceph -s输出的pg数是8832。

按照pg计算公式:220*100/6=3666.67,取最近的2的幂次是4096,8832是怎么得出来的。

- 2026-03-31提问

- 举报

-

(0)

对于4+2纠删码,每个对象有 k+m = 6个分片。每个分片都需要独立的PG来管理其在OSD上的分布。

因此,正确的PG总数计算公式为:

`总PG数 = (OSD总数 × 每个OSD的PG数) / (k + m)`

你提供的公式 `220 * 100 / 6 ≈ 3666` 计算的是数据PG的数量,但系统显示的8832是总PG数(包含所有数据分片和校验分片对应的PG)。

推导总PG数:

`总PG数 ≈ 数据PG数 × (k + m) / k = 3666 × (6 / 4) ≈ 5499`

这个值仍需向上取最近的2的幂次(8192),但与你给出的8832仍有差距。

信息差异可能源于:

1. 你看到的 `ceph -s` 输出中的8832可能是 所有存储池的PG总和,而非单个纠删码池的PG数。请使用 `ceph osd pool ls detail` 确认具体池的`pg_num`。

2. 初始创建池时指定的 `pg_num` 可能并非严格按公式计算。

需要你补充:

1. 执行 `ceph osd pool ls detail` 命令,查看相关纠删码池的具体 `pg_num` 和 `pgp_num` 值。

2. 确认 `ceph -s` 显示的“8832 pg”是全局总数还是特定池的。

- 2026-03-31回答

- 评论(1)

- 举报

-

(1)

ceph osd pool ls detail命令没有在“H3C分布式存储系统_命令参考-6W105-整本手册”里搜索到,这个命令在哪个手册里

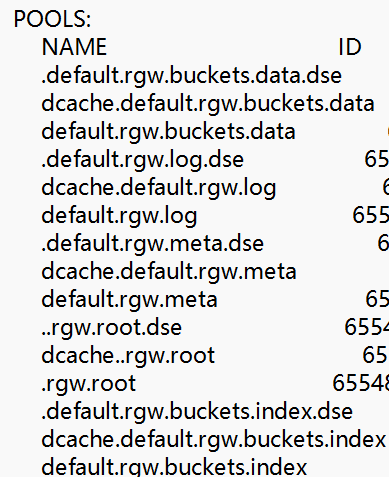

你计算的 4096 是针对单个存储池的推荐 PG 数,而 ceph -s 显示的 8832 是你当前集群中所有 15 个存储池的 PG 总数。

你的计算思路是正确的,使用了 Ceph 官方推荐的公式 (OSD_num * 100) / pool_size,并且正确地考虑了纠删码池的 pool_size 为 k+m = 4+2 = 6,得到了 220 * 100 / 6 ≈ 3667,然后向上取整到 4096。这个计算没有问题。

问题在于,你之前可能将这个公式的结果直接对应到了集群总的 PG 数量上。实际上,这个公式通常是为集群中数据量最大、最重要的那个存储池估算 PG 数量的,而非整个集群的总数。一个集群总的 PG 数是其所有存储池 PG 数的总和。

从你的截图来看,集群中存在 15 个存储池。其中,有三个系列的存储池配置了相似的 PG 数量,它们的 PG 加起来,总和就很容易达到 8832。

你实际看到的 8832 低于这个粗略估算,很可能是每个系列中的“data”池 PG 数较大(比如 4096),而“index”和“log”池的 PG 数相对较小(比如 1024),几个池加起来正好是 8832。

总结来说,你之前的计算是针对单个重要存储池的,而系统显示的 8832 是整个集群所有 15 个存储池的 PG 总数。这个总数符合每个 OSD 承载约 40 个 PG 的推荐负载,并且可能受到了 Ceph PG 自动扩展功能的影响。

- 2026-03-31回答

- 评论(0)

- 举报

-

(1)

编辑答案

亲~登录后才可以操作哦!

确定你的邮箱还未认证,请认证邮箱或绑定手机后进行当前操作

举报

×

侵犯我的权益

×

侵犯了我企业的权益

×

- 1. 您举报的内容是什么?(请在邮件中列出您举报的内容和链接地址)

- 2. 您是谁?(身份证明材料,可以是身份证或护照等证件)

- 3. 是哪家企业?(营业执照,单位登记证明等证件)

- 4. 您与该企业的关系是?(您是企业法人或被授权人,需提供企业委托授权书)

抄袭了我的内容

×

原文链接或出处

诽谤我

×

- 1. 您举报的内容以及侵犯了您什么权益?(请在邮件中列出您举报的内容、链接地址,并给出简短的说明)

- 2. 您是谁?(身份证明材料,可以是身份证或护照等证件)

对根叔社区有害的内容

×

不规范转载

×

举报说明

ceph osd pool ls detail命令没有在“H3C分布式存储系统_命令参考-6W105-整本手册”里搜索到,这个命令在哪个手册里