问题描述:

查询到H3C R4930 G5的p3p1和p3p2这两个口丢包。已经更换新的网卡、新的光模块和新的线缆,问题依旧存在,尝试过将同一bond的p3p1和p16p1光纤进行对调,依旧显示的是p3p1丢包,排除了交换机端的问题,交换机开了stp,环路和网络风暴的可能性很低,现在不知道是什么问题?

- 2026-04-09提问

- 举报

-

(0)

错误类型解读

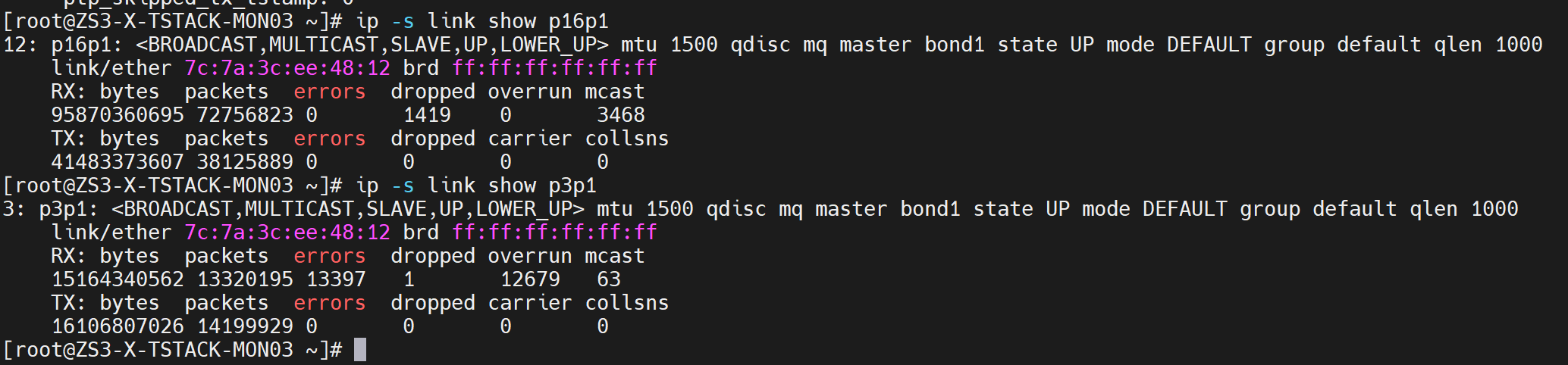

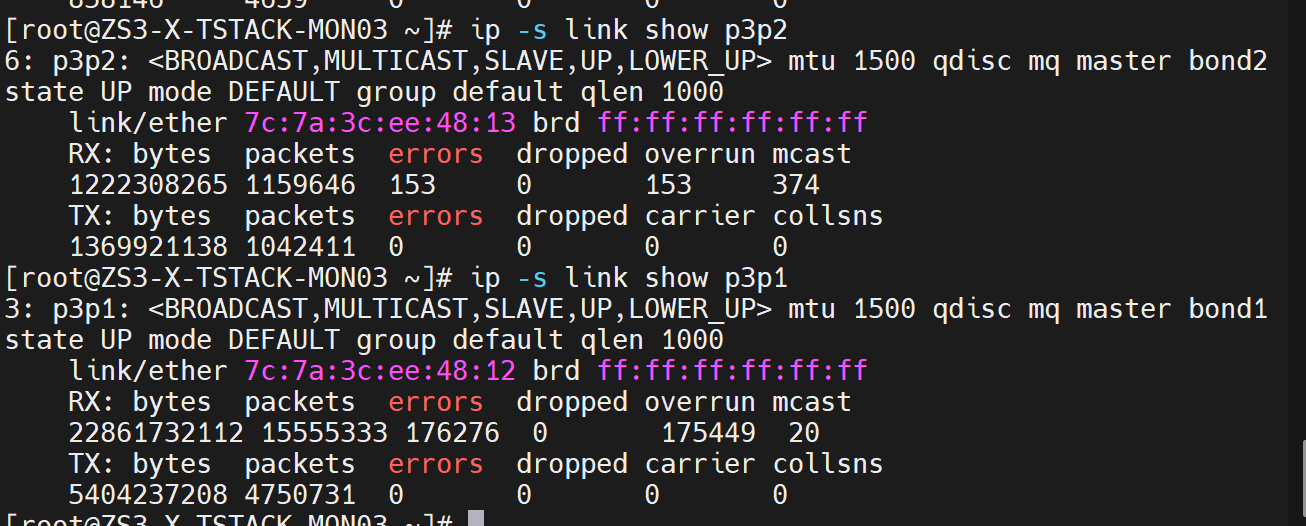

结合你 ip -s link show 的输出,我们来具体看看这两个高得吓人的指标到底意味着什么:

errors(RX errors):这个字段通常是物理层问题的汇总。光链路质量差(比如光衰过大)、光模块故障、线缆损坏或接头接触不良,都会导致接收到的数据包损坏,从而被标记为错误。overruns(RX overruns):这直接指向服务器性能瓶颈。它表明网卡的硬件缓冲区(Ring Buffer)已经塞满了,但操作系统的驱动程序没能及时取走这些数据,导致新来的数据包直接被网卡硬件丢弃。

故障根因推断

综合以上信息,p3p1 口的故障根本原因极有可能是:服务器CPU或PCIe总线性能不足,导致无法及时处理p3p1口的中断请求,进而引发了大量的 overruns 和 errors。

“对调光纤”试验的铁证:这个现象非常关键。故障始终跟随

p3p1这个端口,而不是跟随光纤链路。这完美地排除了光模块、光纤、对端交换机接口等外部物理链路的问题,将故障点锁定在服务器内部的p3p1端口或其关联的系统资源(如PCIe通道、CPU中断处理能力)上。errors与overruns的关系:当一个网口因为处理不过来而overrun时,接收数据的行为就可能变得不稳定。一个部分接收的数据包,在物理层看来就和损坏的数据包一样,从而也会被记录为errors。所以,二者数量几乎一致,恰恰印证了性能瓶颈才是元凶。

在R4930 G5服务器上,当内存配置不足时,会导致CPU处理中断的资源不足,从而引发网卡频繁丢包。

排查思路与解决方案

1. 核心排查方向:服务器性能与PCIe配置

你应该将排查重点完全转移到服务器内部,因为问题几乎可以确定就在p3p1端口自身。

检查系统资源:

内存配置:核实服务器的内存是否按官方推荐配置(如每个CPU至少配置4条内存,确保每个NUMA节点都有内存资源),内存配置不足可能会引发此类问题。

CPU中断处理:检查

p3p1口的中断是否集中在某个或某几个CPU核心上,CPU的si(软中断)使用率是否过高。

检查PCIe配置:

链路速度:确认

p3p1所在的PCIe插槽是否工作在正确的速度(如PCIe 3.0/4.0 x8)上,是否存在降速的情况。尝试更换PCIe插槽:如果服务器有空闲的PCIe插槽,可以尝试将p3p1对应的网卡插到另一个PCIe插槽上。这有助于排查当前插槽是否存在物理故障或资源冲突。

更新固件/驱动:检查并更新服务器的BIOS、BMC固件,以及网卡的最新驱动程序。

2. 辅助排查方向:软件调优与硬件交叉验证

在排查核心方向的同时,可以验证一些软件层面的可能性。

检查Bonding模式:确认当前

bond1和bond2的工作模式(cat /proc/net/bonding/bond1)。balance-xor或802.3ad这类需要交换机配合的模式,如果配置不当也会导致问题。你可以尝试临时将bond模式改为active-backup,并设置p16p1为主网卡,看p3p1作为备用时errors和overruns是否还增长。临时测试:在不影响业务的前提下,可以考虑将

p3p1从bond1中移除,给它单独配置一个IP进行测试。如果问题依旧,则更说明是网卡本身或服务器资源的问题;如果问题消失,则可能与Bonding配置有关。

- 2026-04-09回答

- 评论(0)

- 举报

-

(0)

一、先确认关键信息(你先执行一遍)

# 1. 看接口丢包、错包

ip -s link show p3p1

ip -s link show p3p2

ip -s link show bond0

# 2. 看驱动、固件、速率双工

ethtool p3p1

ethtool -i p3p1 # driver、version、firmware-version

# 3. 看网卡硬件统计(rx_errors / rx_dropped / rx_fifo_errors / rx_missed_errors)

ethtool -S p3p1 | grep -iE 'error|drop|fifo|missed'

ethtool -S p3p2 | grep -iE 'error|drop|fifo|missed'

# 4. 看 Bond 模式与状态

cat /proc/net/bonding/bond0

# 5. 看系统日志(网卡异常、PCIe错误)

dmesg -T | grep -iE 'p3p1|eth|nic|bnx2|ixgbe|mlx|firmware|pcie|error'

journalctl -k | grep -iE 'p3p1|error|pcie'

# 6. 看中断、CPU 软中断(是否 CPU 处理不过来)

cat /proc/interrupts | grep -E 'p3p1|p3p2'

top -H

二、最可能原因(按优先级)

1)p3p1 所在 PCIe 槽位 / PCIe 控制器 硬件或兼容性问题

- R4930 G5 是 2U 双路海光服务器,p3p1/p3p2 通常在 PCIe switch 或某一 CPU 的 PCIe root complex。

- 你已经换过网卡,但没换槽位 → 故障跟着槽位 / PCIe 控制器走。

- 表现:

- 换网卡、模块、线缆 → 还是 p3p1 丢包

- 对调光纤 → 依然 p3p1 丢(因为系统认的是 p3p1 这个逻辑口 + 槽位)

- 验证:

- 把 p3p1/p3p2 网卡 换到另一个空闲 PCIe 槽位(换 CPU 节点更佳)

- 重启后看新网卡名(可能变成 p4p1/p4p2)

- 重新配 Bond,观察丢包是否 转移到新网卡 或 消失

- 结论:

- 换槽位后丢包消失 → 原 PCIe 槽位 / 主板 PCIe 控制器 硬件故障

- 换槽位仍丢 → 驱动 / 内核 / 配置问题

2)网卡驱动 / 固件版本 BUG(最常见软件原因)

- H3C 服务器用的多是 Mellanox (mlx5_core)、Intel ixgbe/i40e 或 Broadcom bnx2x/bnxt。

- 特定版本驱动存在:

- RSS 队列异常

- 中断风暴

- RX ring 满丢包(

rx_fifo_errors/rx_no_buffer_count) - PCIe 总线错误(AER)

- 处理:

- 去 H3C 官网下载 R4930 G5 对应 OS 最新网卡驱动 + 网卡固件 + BIOS

- 先升级 网卡固件(firmware) → 重启

- 再升级 驱动 → 重启

- 升级 服务器 BIOS(HDM 里更新)

3)RX Ring Buffer 太小(高并发下必丢包)

# 查看当前队列

ethtool -g p3p1

# 放大 RX/TX 队列(临时)

ethtool -G p3p1 rx 4096 tx 4096

ethtool -G p3p2 rx 4096 tx 4096

- 观察 10 分钟:

rx_dropped/rx_fifo_errors是否不再增长。

4)中断不均衡 / 软中断 CPU 瓶颈(ksoftirqd 占满)

- 现象:

top -H看到 ksoftirqd/xx CPU 100%cat /proc/softirqsNET_RX 暴增- 只有 p3p1 丢(中断全压在某几个 CPU)

- 处理:bash运行

# 1. 开启 irqbalance systemctl enable --now irqbalance # 2. 检查网卡多队列是否开启 ethtool -l p3p1 # 3. 开启 RSS 哈希(流量打散到多队列) ethtool -X p3p1 hfunc toeplitz

5)Bond 模式 + 交换机 LAG 配置不匹配

cat /proc/net/bonding/bond0

- Mode:

- mode=0 (balance-rr):交换机必须 静态聚合

- mode=4 (802.3ad):交换机必须 LACP 动态聚合

- mode=1 (active-backup):最稳妥,先切到 mode=1 测试

- MII Status:是否全 up

- Slave Interface 流量是否均匀测试:

- 临时把 Bond 改成 mode=1(主备)

- 手动切换 active 到 p16p1:

ifenslave -c bond0 p16p1 - 看 p3p1 丢包是否停止

- 是:Bond 负载均衡算法问题(哈希不对称)

- 否:p3p1 本身硬件 / 驱动问题

6)MTU 不匹配 / JUMBO 帧异常

ip link show p3p1

# 两端 MTU 必须一致(通常 1500 或 9000)

- 一端 9000、一端 1500 → 大量分片丢包。

7)BIOS 设置:PCIe AER / ASPM / 电源管理

- 进入 HDM / BIOS:

- 关闭 PCIe Active State Power Management (ASPM)

- 关闭 PCIe Advanced Error Reporting (AER) 或改为 非致命

- 开启 PCIe Max Read Request Size(调大)

- 关闭 节能模式 / C6 / C3 休眠

- 很多服务器 节能导致 PCIe 响应慢、丢包。

8)p3p1 名称绑定:udev 规则 / 网卡序号错乱

- 系统把 固定物理口 强制命名为 p3p1,即使换网卡也不变。

- 确认:bash运行

# 看网卡 MAC、槽位、名称对应 lspci | grep -i eth dmidecode -t slot - 必要时清理

/etc/udev/rules.d/里的网卡命名规则,重启重命名。

三、下一步建议(最有效)

- 先换 PCIe 槽位(最能定位是否硬件槽位故障)

- 把 p3p1/p3p2 网卡移到 另一个 CPU 的 PCIe 槽位

- 重新配 Bond,观察丢包

- 升级驱动 + 固件 + BIOS(H3C 官方最新)

- 临时切 Bond mode=1 主备 测试

- 放大 RX Ring、开启 irqbalance、关闭 PCIe 节能

四、典型结论(你这种场景)

- 换槽位后丢包消失 → 主板 PCIe 槽位 / 控制器硬件故障(报修)

- 换槽位仍丢 → 驱动 / 固件 BUG(升级即可)

- 切 mode=1 后不丢 → Bond 负载均衡 + 交换机配置问题

- 2026-04-09回答

- 评论(0)

- 举报

-

(0)

暂无评论

1. 确认丢包类型与位置:

display interface p3p1

display interface p3p2

查看 `Input errors`、`CRC`、`Frame errors`、`Overruns`、`Ignored`、`Output errors`、`Collisions` 等具体计数。重点区分是物理层错误(如CRC)还是二层/三层丢包。

2. 检查接口协商状态:

display transceiver diagnosis interface p3p1

display transceiver diagnosis interface p3p2

检查光模块的收发光功率是否在正常范围。同时检查接口速率、双工模式是否与对端匹配(`display interface brief`)。

3. 检查服务器侧配置:

* 确认服务器上该物理接口(对应p3p1/p3p2)的驱动是否为最新且兼容。

* 检查服务器上是否启用了`ethtool`等工具的`LRO/GRO`或`TSO`等卸载功能,尝试临时禁用测试:

ethtool -K <eth_name> lro off gro off tso off gso off

* 检查服务器系统日志(`dmesg`、`/var/log/messages`)是否有网卡相关错误(如`buffer overrun`、`timeout`)。

4. 检查服务器网络配置:

* 确认`bonding`模式配置正确。如果是`LACP`(模式4),需确保服务器与交换机配置一致(`display lacp system-id`、`display link-aggregation verbose`)。

* 检查`MTU`设置是否端到端一致(服务器、交换机、对端设备)。

5. 深入定位:

* 在服务器上使用`tcpdump`或`ethtool -S <eth_name>`抓取并分析该接口的详细统计,观察错误包增长的具体条件。

* 如果条件允许,将服务器连接到另一台交换机的相同类型端口进行对比测试,彻底隔离环境因素。

需要补充的信息:

1. `display interface` 命令输出的具体错误计数类型。

2. 服务器操作系统版本、网卡型号及驱动版本。

3. 交换机的具体型号、软件版本及端口配置(如是否配置了`flow-control`)。

4. 错误包增长是否与流量负载或特定业务有相关性。

- 2026-04-09回答

- 评论(0)

- 举报

-

(0)

暂无评论

编辑答案

亲~登录后才可以操作哦!

确定你的邮箱还未认证,请认证邮箱或绑定手机后进行当前操作

举报

×

侵犯我的权益

×

侵犯了我企业的权益

×

- 1. 您举报的内容是什么?(请在邮件中列出您举报的内容和链接地址)

- 2. 您是谁?(身份证明材料,可以是身份证或护照等证件)

- 3. 是哪家企业?(营业执照,单位登记证明等证件)

- 4. 您与该企业的关系是?(您是企业法人或被授权人,需提供企业委托授权书)

抄袭了我的内容

×

原文链接或出处

诽谤我

×

- 1. 您举报的内容以及侵犯了您什么权益?(请在邮件中列出您举报的内容、链接地址,并给出简短的说明)

- 2. 您是谁?(身份证明材料,可以是身份证或护照等证件)

对根叔社区有害的内容

×

不规范转载

×

举报说明

暂无评论